Code

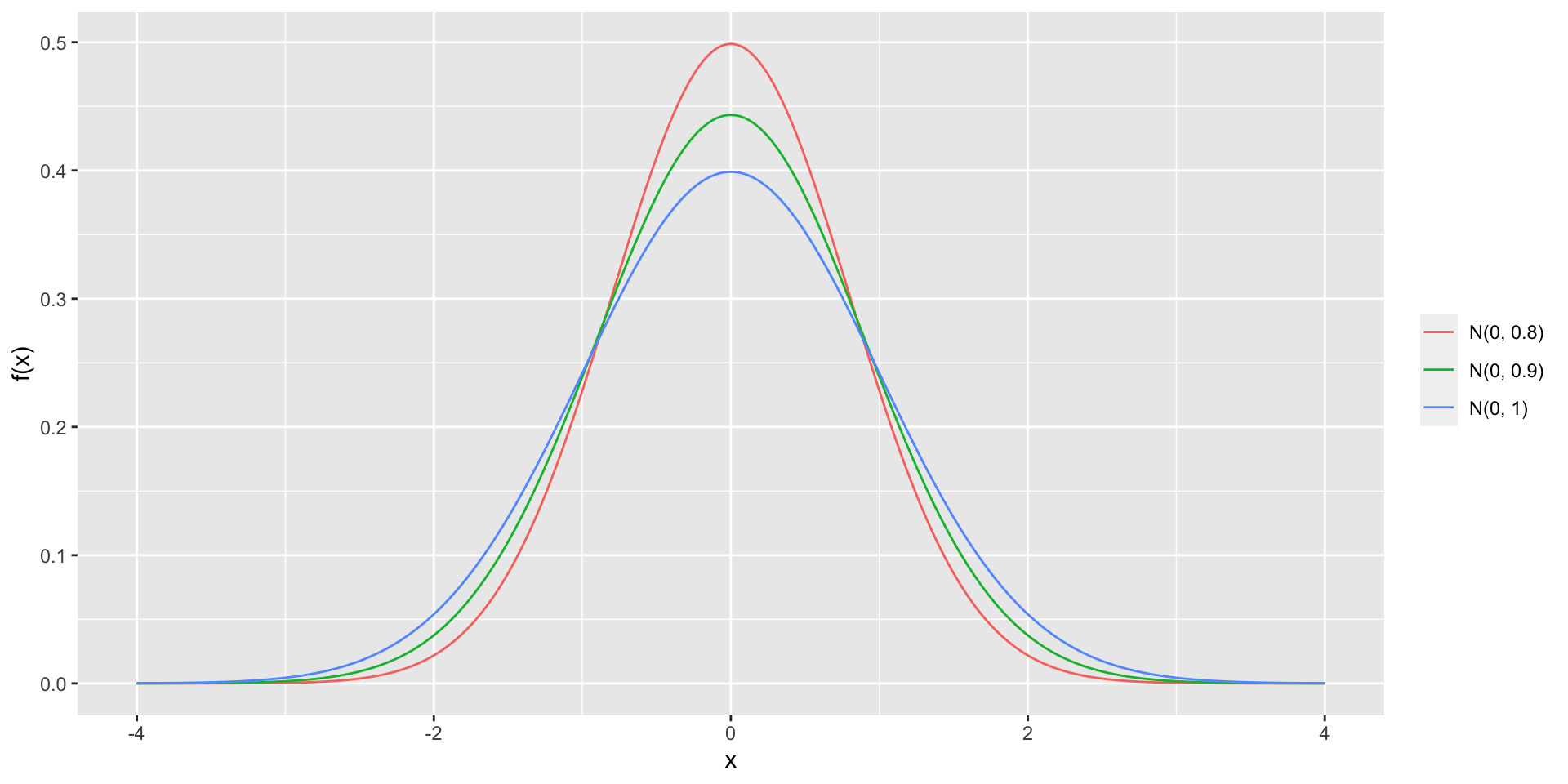

library(ggplot2)

a <- seq(-4, 4, by = 0.001)

n <- length(a)

dados <- data.frame(

distri = rep(c("N(0, 1)", "N(0, 0.9)", "N(0, 0.8)"), each = n),

x = rep(a, 3),

y = c(dnorm(a), dnorm(a, 0, 0.9), dnorm(a, 0, 0.8)))

ggplot(data = dados) + geom_line(aes(x, y, color = distri)) +

ylab("f(x)") +

theme(legend.title = element_blank())